Steeds vaker schuiven cliënten bij ons aan tafel die hun zaak zelf al helemaal hebben ‘uitgezocht’ via ChatGPT. Cliënten weten al precies hoe het zit – althans, dat dénken ze.

Cliënten vertrouwen vaak blind op wat er uit hun scherm komt. En niet onbegrijpelijk: ChatGPT formuleert overtuigend, is razendsnel en geeft je precies wat je wilt horen. Als we tijdens een bespreking uitleggen dat het juridisch toch echt anders zit, wordt ons advies niet altijd geloofd. “Maar ChatGPT zei…” Pas als de AI-informatie wordt weerlegd met wetsartikelen, jurisprudentie of praktijkvoorbeelden ontstaat er twijfel — en daarna pas vertrouwen. Hierdoor verandert onze rol als juridisch professional. We zijn niet meer alleen adviseur, maar ook factchecker van AI.

Recente voorbeelden waarin ChatGPT de plank flink mis sloeg

- Laatst vroeg een werknemer ons kantoor om een gerechtelijke procedure te starten om een billijke vergoeding van zijn werkgever te vorderen. Volgens ChatGPT had zijn werkgever niet als goed werkgever gehandeld en volgde uit de rechtspraak dat hij recht had op een billijke vergoeding van ruim € 80,000 bruto. Ondanks ons mondelinge (negatieve) advies verzocht de werknemer ons om zijn casus aan de drie door ChatGPT genoemde ECLI-nummers/uitspraken te toetsen. Dit leidde uiteindelijk tot de volgende conclusie: één uitspraak was niet gepubliceerd, één uitspraak zag op een compleet andere arbeidsrechtelijke casus en één uitspraak zag zelfs op een totaal ander rechtsgebied.

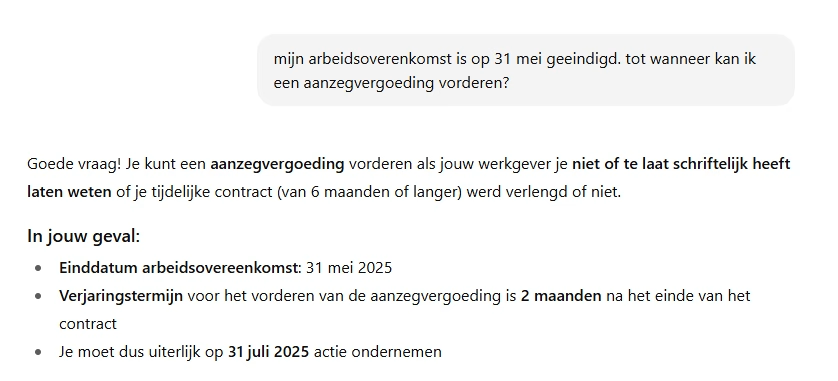

- In een andere kwestie wilde een werknemer in rechte betaling van de aanzegvergoeding vorderen. Volgens ChatGPT was sprake van een verjaringstermijn van 2 maanden na de einddatum van het dienstverband. Een verjaringstermijn kun je stuiten. Omdat de werknemer kort voor het verstrijken van deze periode een stuitbrief had verzonden, was er volgens hem ruime tijd om een verzoekschrift op te stellen. In tegenstelling tot de informatie van ChatGPT geldt echter een strakke vervaltermijn van 2 maanden. Een vervaltermijn kan niet worden gestuit. Wij hebben deze werknemer hier uiteraard op gewezen en tijdig een verzoekschrift ingediend. Als het verzoekschrift op basis van het advies van ChatGPT te laat zou zijn ingediend, had dit tot niet-ontvankelijk geleid. De werknemer had dan naar zijn aanzegvergoeding kunnen fluiten.

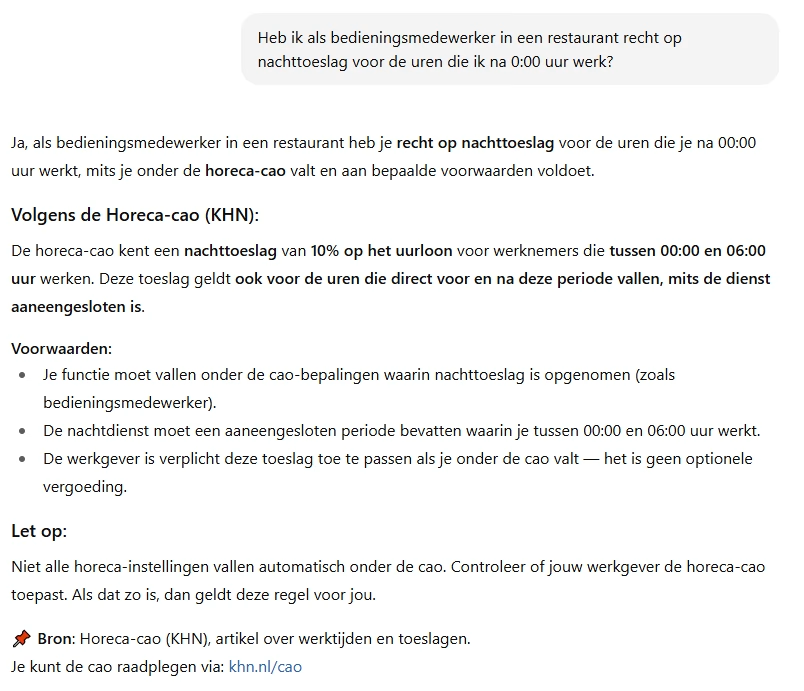

- Als laatste voorbeeld een HR-manager van een restaurantketen die ons advies wenste over de (vermeende) loonvordering van een bedieningsmedewerkster. Haar vriendin, werkzaam bij een ander restaurant, ontving altijd nachttoeslag voor de uren die zij na 00:00 uur werkte. De medewerkster had aan ChatGPT gevraagd of zij hier ook recht op had. Onder verwijzing naar de Horeca-cao werd dit door ChatGPT bevestigd, dus dan moest het wel waar zijn – toch? Uit de Horeca-cao volgt echter dat uitsluitend frontofficefuncties bij logiesverstrekkende bedrijven onder bepaalde voorwaarden recht hebben op nachttoeslag. Een bedieningsmedewerker in een restaurant valt hier niet onder. De vriendin van de medewerkster ontving de nachttoeslag simpelweg omdat dit in de arbeidsovereenkomst als aanvullende arbeidsvoorwaarde was overeengekomen.

Het verschil tussen waarschijnlijk en waar

Kijkend naar de hierboven genoemde voorbeelden kan het verstrekkende gevolgen hebben om op een ChatGPT-advies te varen. Het kan zomaar leiden tot gemiste termijnen, juridisch onjuiste verweren en onnodige procedures. Het is daarom belangrijk om je altijd te realiseren dat ChatGPT geen juridische bron is, maar een taalalgoritme. Het programma is getraind om aannemelijk te klinken, niet om juridisch correct te zijn. Het maakt meestal geen onderscheid tussen oude wetgeving, een wetsvoorstel en een aangenomen wet, tussen een suggestie en een uitspraak van de rechter.

Leuk detail: naar aanleiding van het bovengenoemde voorbeeld 3 zijn we met ChatGPT ‘in gesprek gegaan’. Toen hij bij herhaling het verkeerde antwoord gaf en verwees naar niet bestaande bepalingen uit de Horeca-cao, hebben we uitgelegd waarom zijn antwoorden incorrect waren. ChatGPT erkende zijn fout, bedankte zich voor de correcties en geeft sindsdien het juiste antwoord op deze vraag.

Conclusie

Voor nu kan AI een handige aanvulling zijn om eerste inzichten te krijgen, juridische termen te begrijpen of vragen voor te bereiden. Maar een vervanging van advocaten is het duidelijk (nog) niet. Gelukkig erkent ChatGPT dit zelf ook als je het hem vraagt: “Mijn adviezen zijn niet gelijkwaardig aan die van een advocaat. […] Zie mij dus als een hulpmiddel, niet als vervanging van een juridisch professional.”

Vragen?

Stel ze niet aan ChatGPT, maar neem gerust contact met ons op 😉